I sistemi sanitari negli Stati Uniti stanno lanciando nuovi chatbot di intelligenza artificiale (AI) per aiutare i pazienti a porre domande mediche e ad accedere agli appuntamenti più rapidamente in un contesto di crescente domanda di assistenza sanitaria rapida, anche se i medici rimangono divisi sull’implementazione.

Alcuni vedono gli aspetti positivi dell’accesso dei pazienti Piattaforme di intelligenza artificiale focalizzate sulla clinica per porre domandementre altri avvertono che devono essere standard rigorosi mantenuti per limitare i rischi potenziali.

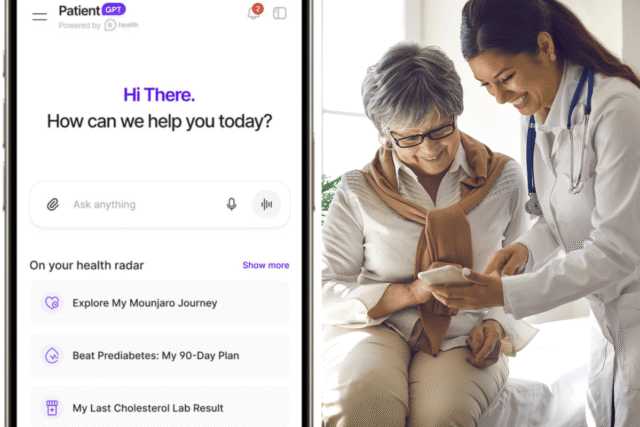

Hartford HealthCare ha recentemente lanciato il suo Patient GPT, un chatbot creato dalla società clinica di intelligenza artificiale K Health, per i suoi pazienti nel Connecticut, mentre Sutter Health e Reid Health, con sede in California, che serve Indiana e Ohio, hanno lanciato Emmie, un chatbot creato dalla società di software sanitario Epic.

Circa il 25% degli americani ha utilizzato uno strumento di intelligenza artificiale o un chatbot per informazioni o consigli sanitari, principalmente come strumento supplementare per la propria cura. secondo secondo un sondaggio Gallup, e gli utenti delle “comunità rurali sottoservite” inviano una media di quasi 600.000 messaggi sanitari a settimana, secondo un rapporto di gennaio di OpenAI.

Allo stesso tempo, ospedale i tempi di attesa negli Stati Uniti stanno peggiorando. I pazienti ora spesso devono aspettare in media un mese per vedere un medico, ha mostrato un rapporto del 2025 di AMN Healthcare, segnando un aumento del 19% rispetto al 2022.

OpenAI ha affermato che sta lanciando il proprio bot sanitario dedicato, ChatGPT Health, integrato in ChatGPT, poiché cresce la domanda di una guida sanitaria rapida e accessibile, e ora gli ospedali stanno entrando nella tecnologiaricorrere a strumenti di intelligenza artificiale interni progettati specificamente per ambienti clinici.

Come funzionano i nuovi chatbot AI creati clinicamente

Emmie, lanciato da Sutter Health e Reid Health, è un assistente AI integrato nel portale paziente sicuro di Epic MyChart, ha detto Trevor Berceau, direttore della ricerca e sviluppo di Epic Newsweekche, secondo lui, è stato progettato per “aiutare i pazienti a comprendere e gestire le loro cure”.

Ha affermato che Emmie affronta diverse sfide incontrate da milioni di americani che utilizzano chatbot commerciali di intelligenza artificiale per rispondere alle loro domande mediche, come non considerare la loro storia medica nelle risposte, nonché preoccupazioni su come le società di intelligenza artificiale potrebbero utilizzare i loro dati medici.

Poiché Emmie è integrata con le cartelle cliniche dei pazienti, le sue risposte “tengono conto della storia del paziente”, ha affermato Berceau. Ciò significa anche che le informazioni condivise dai pazienti sono protette dall’Health Insurance Portability and Accountability Act (HIPAA), una legge federale che protegge le informazioni mediche degli individui con rigorosi standard di privacy e sicurezza.

Laura Wilt, Chief Digital Officer di Sutter Health, ha affermato che i pazienti avranno quindi accesso a “risposte specifiche per loro e per la loro salute all’interno di Emmie”, a differenza di altri assistenti di intelligenza artificiale commerciali.

Gli usi principali di Emmie riguardano i risultati di laboratorio e le domande post-consultazione, domande di salute generale e richieste di consulenza, ha affermato Berceau. Anche se ha aggiunto che, come qualsiasi strumento di intelligenza artificiale, “le persone non dovrebbero prendere decisioni terapeutiche basate esclusivamente sui risultati di Emmie”.

“Ciò che fa Emmie è aiutarli a comprendere meglio la loro salute in modo che possano prepararsi per discussioni informate con i loro caregiver”, ha detto.

Ridurre i tempi di attesa per gli appuntamenti

Lo ha detto Allon Bloch, amministratore delegato di K Health Newsweek che il GPT del paziente abbia accesso anche alla cartella clinica del paziente. Consente ai pazienti di creare un profilo con i loro farmaci, i risultati dei test recenti e la storia medica inclusi in diverse sezioni, un video dimostrativo della piattaforma condiviso con Newsweek ha mostrato.

Bloch ha anche affermato che la piattaforma offre ai pazienti la possibilità di prenotare un appuntamento online con un medico 24 ore su 24, 7 giorni su 7. Ha detto che un paziente potrebbe, a seconda della domanda, ottenere un appuntamento in appena 15 minuti se lo desidera, oppure potrebbe più facilmente ottenere un appuntamento la sera o al di fuori dell’orario clinico.

Ha detto che il motivo per cui ciò è possibile è perché “facciamo gran parte del lavoro per il medico”, poiché la piattaforma può raccogliere le domande dei pazienti e attingere alla loro cartella clinica, rendendo più semplice per il medico rivedere i loro problemi di salute.

“Un medico potrebbe impiegare 20 minuti solo per leggere una cartella clinica, per non parlare di fare il resoconto medico”, ha detto. “Ora è tutto lì e pronto per il dottore.”

Ha aggiunto che pensa che questa sia una “opportunità globale”, poiché la tecnologia ha la capacità di semplificare le problematiche avvertite nel settore sanitario in tutto il mondo, come il coordinamento dei documenti dei pazienti, degli appuntamenti e delle prescrizioni.

Lo ha detto il dottor Padmanabhan Premkumar, presidente dell’Hartford Healthcare Medical Group Newsweek che “a differenza dei chatbot generici che possono mancare di contesto clinico o di un endpoint definitivo, la nostra piattaforma è progettata con percorsi clinici strutturati”, percorsi che, secondo lui, significano che il chatbot comprende la storia medica specifica del paziente all’interno di un “ecosistema sicuro” per “selezionarlo, se necessario, verso un appuntamento dal medico o la risorsa clinica appropriata”.

Gli ospedali citano i primi feedback positivi

L’implementazione è ancora agli inizi, ma Premkumar ha affermato di aver già ricevuto alcuni feedback che indicano che i pazienti “apprezzano la maggiore accessibilità e la capacità di semplificare la complessa navigazione sanitaria”.

“Ho utilizzato personalmente la piattaforma e l’ho trovata molto vantaggiosa, e l’ho consigliata anche ai miei familiari”, ha dichiarato il dottor Ajay Kumar, vicepresidente esecutivo e direttore clinico di Hartford HealthCare. Newsweek.

Ha affermato di credere che Patient GPT potrebbe “aggiungere un valore significativo per i pazienti se la privacy e gli standard HIPAA fossero pienamente rispettati”.

“Se implementata in modo responsabile e sicuro, l’intelligenza artificiale può aiutare i pazienti a comprendere meglio le loro informazioni mediche e guidarli verso cure adeguate”, ha affermato. “In queste condizioni, sostengo questo tipo di innovazione.”

Che dire della privacy e delle allucinazioni?

Gli americani sono diventati sempre più scettici nei confronti dell’intelligenza artificiale e più della metà della popolazione è preoccupata per il rischio che la tecnologia diffonda contenuti e informazioni fuorvianti. secondo alcuni sondaggi. Nel settore sanitario, le informazioni mediche fuorvianti potrebbero avere gravi implicazioni, in particolare se i pazienti chiedono consigli senza scegliere di parlare anche con un medico.

Alla domanda su queste potenziali preoccupazioni, Bloch, CEO di K Health, ha affermato che è importante ricordare che anche “i medici commettono errori medici” e che “non stiamo parlando di un sistema con zero errori”, ma che se i pazienti non hanno accesso a informazioni mediche di alta qualità o evitano di parlare con i medici di un problema a causa dei lunghi tempi di attesa, il risultato potrebbe essere “molto peggiore”.

Berceau ha affermato che in Epic “ci impegniamo molto nell’ingegneria tempestiva e contestuale per ottenere risultati accurati” e che l’azienda dispone di “una solida suite di test automatizzati che esegue migliaia di permutazioni di questi test”. Ha affermato che queste misure consentono loro di “monitorare e convalidare l’output di Emmie su base giornaliera ed evitare problemi come la deriva del modello che possono influire sulla precisione”.

Per quanto riguarda i potenziali problemi sulla privacy dei dati, ha aggiunto che le disposizioni dell’HIPAA proteggono le informazioni che i pazienti condividono con Emmie, poiché secondo la legge, i sistemi sanitari sono tenuti a mantenere le informazioni dei pazienti al sicuro, “proprio come lo sono con il resto della cartella clinica”, il che li distingue dai chatbot dei consumatori.

Kumar ha riconosciuto che “sarebbe preoccupante” che questi chatbot venissero utilizzati per rispondere a domande mediche se “non fossero state adottate una governance forte e misure di sicurezza adeguate”.

“Tuttavia, il nostro approccio richiede un’analisi rigorosa attraverso protocolli di ricerca consolidati, nonché la supervisione da parte di una struttura di governance multidisciplinare dell’IA”, ha affermato. “Questo mi dà la certezza che i rischi vengono attentamente valutati e gestiti.”

Cosa pensano i medici

I medici sembrano divisi sul fatto se lo considerino un passo avanti positivo per il settore sanitario o se susciti preoccupazioni.

Lo ha detto Nigam Shah, professore di Medicina alla Stanford University Newsweek che pensava che questa fosse una mossa “nettamente positiva” per il settore sanitario.

“Le esigenze di assistenza non si fermano quando la clinica chiude, e il pronto soccorso non è il luogo più appropriato per molte esigenze di assistenza”, ha affermato, aggiungendo che questi strumenti “colmano il divario tra la chiusura delle cure urgenti e l’apertura della clinica il giorno successivo”.

Tuttavia ha affermato che questi strumenti “non sono perfetti e commettono errori” e che è necessario porsi domande su come questi strumenti verrebbero effettivamente monitorati.

Lo ha detto Suchi Saria, professore di informatica e politica sanitaria alla Johns Hopkins University Newsweek che ciò che conta è anche lo standard a cui sono tenuti questi strumenti.

“La stessa tecnologia può migliorare significativamente l’assistenza sanitaria o introdurre tranquillamente dei rischi, a seconda di quanto rigorosamente viene costruita, convalidata e monitorata”, ha affermato. “Nel settore sanitario, la questione non è se gli errori si verificano, ma piuttosto quanto velocemente questi sono stati rilevati e corretti prima che si verificassero danni.”

Ciò significa che il monitoraggio è particolarmente importante e Saria ha affermato che “dobbiamo allontanarci dall’idea che l’intelligenza artificiale rivolta al paziente possa operare secondo uno standard più leggero”, poiché “se uno strumento influenza la comprensione, le decisioni o il comportamento del paziente, dovrebbe essere tenuto allo stesso livello di qualsiasi altro strumento clinico”, cosa che ha aggiunto oggi non è sempre così.

Se questi chatbot basati sull’intelligenza artificiale alla fine allenteranno la pressione su un sistema sanitario sovraccarico o introdurranno nuovi rischi potrebbe dipendere meno dalla tecnologia stessa che dall’attenzione con cui gli ospedali li monitorano, governano e integrano nelle cure cliniche.

In un’era polarizzata, il centro viene liquidato come insipido. A Newsweekil nostro è diverso: Il Centro Coraggioso: non è “entrambe le parti”, è acuto, stimolante e vivo di idee. Seguiamo i fatti, non le fazioni. Se questo sembra il tipo di giornalismo che vuoi vedere prosperare, abbiamo bisogno di te.

Quando tu diventare un membro di Newsweeksostieni una missione per mantenere il centro forte e vibrante. I membri godono di: navigazione senza pubblicità, contenuti esclusivi e conversazioni con gli editor. Aiutaci a mantenere il centro coraggioso. Iscriviti oggi.