Emil Michael, responsabile tecnologico del Dipartimento di Guerra, ha descritto pubblicamente il momento cruciale in cui la leadership militare si è resa conto della portata della dipendenza del Pentagono dalla tecnologia AI di Anthropic, una scoperta che ha preceduto la recente rottura del loro rapporto.

Emil Michael, sottosegretario del Dipartimento della Guerra per la ricerca e l’ingegneria e responsabile della tecnologia, ha fornito approfondimenti dettagliati sugli eventi che hanno portato alla guerra. controversia pubblica tra il Pentagono e Anthropic durante un’apparizione di venerdì su Podcast completo.

La consapevolezza è arrivata in seguito all’operazione militare in Venezuela all’inizio di gennaio che ha portato alla cattura del dittatore Nicolas Maduro. Dopo il raid, Anthropic ha contattato Palantir per chiedere se la sua intelligenza artificiale fosse stata utilizzata nell’operazione. Sebbene Anthropic abbia descritto questa indagine come una procedura di routine, sia il Pentagono che Palantir l’hanno interpretata come un potenziale segnale di avvertimento sul futuro accesso alla tecnologia.

Michael ha raccontato la sua preoccupazione immediata riguardo alle implicazioni di questa dipendenza. “Mi sono detto, porca miseria, e se questo software non funzionasse, qualche guardrail si sollevasse, si verificasse qualche rifiuto per il prossimo combattimento come questo e lasciassimo la nostra gente a rischio?” Michael ha detto. “Così sono andato dal Segretario Hegseth, ho detto che ciò sarebbe accaduto ed è stato come un ‘whoa moment’ per l’intera leadership del Pentagono che siamo potenzialmente così dipendenti da un fornitore di software senza un’altra alternativa.”

Fino a poco tempo fa, Claude di Anthropic rappresentava l’unico modello di intelligenza artificiale approvato per l’uso in ambienti militari classificati. L’azienda con sede a San Francisco ha dichiarato pubblicamente il suo impegno patriottico nella difesa degli Stati Uniti, pur sostenendo che non permetterà che la sua intelligenza artificiale venga utilizzata per la sorveglianza nazionale di massa o per sistemi d’arma autonomi.

I funzionari del Pentagono hanno affermato che intendevano utilizzare l’intelligenza artificiale solo in scenari legali e hanno rifiutato qualsiasi restrizione da parte della società che andasse oltre i vincoli legali. Quando la scorsa settimana i negoziati non sono riusciti a produrre un compromesso, il presidente Donald Trump ha emesso un ordine in cui invitava il governo federale a farlo smettere di usare Anthropicconcedendo al Pentagono un periodo di transizione di sei mesi. Il segretario alla guerra Pete Hegseth ha inoltre designato la società come un rischio per la catena di approvvigionamento, vietando agli appaltatori di utilizzare la sua tecnologia per lavori legati al settore militare.

Durante l’intervista al podcast, Michael ha espresso preoccupazione per la possibilità che uno sviluppatore disonesto manipoli il modello per comprometterne l’efficacia militare, addestrandolo a produrre deliberatamente informazioni false o programmandolo per ignorare le istruzioni.

A seguito di queste preoccupazioni, Michael si è rivolto a OpenAI, che successivamente ha negoziato un accordo simile a quello originale di Anthropic. Anche xAI di Elon Musk ha ottenuto l’accesso a sistemi classificati e il Pentagono sta lavorando per garantire l’approvazione dell’intelligenza artificiale di Google in ambienti classificati.

“Non sono di parte”, ha dichiarato Michael. “Li voglio tutti e basta. Voglio dare a tutti gli stessi termini esatti perché ho bisogno di ridondanza.”

Michael ha riconosciuto che Anthropic era diventata profondamente integrata all’interno del Dipartimento della Guerra, mentre altre società di intelligenza artificiale non avevano perseguito i clienti aziendali in modo così aggressivo fornendo ingegneri in servizio.

La disputa tra il Pentagono e Anthropic sottolinea le tensioni culturali tra l’establishment della difesa e la Silicon Valley. Sebbene il settore tecnologico abbia radici storiche nell’innovazione militare, molte aziende si sentono sempre più a disagio con l’applicazione delle loro tecnologie alla guerra. Le onde d’urto continuano a farsi sentire nel settore dell’intelligenza artificiale, come ad esempio recente partenza della robotica di OpenAI affronta le preoccupazioni sull’accordo con il Pentagono.

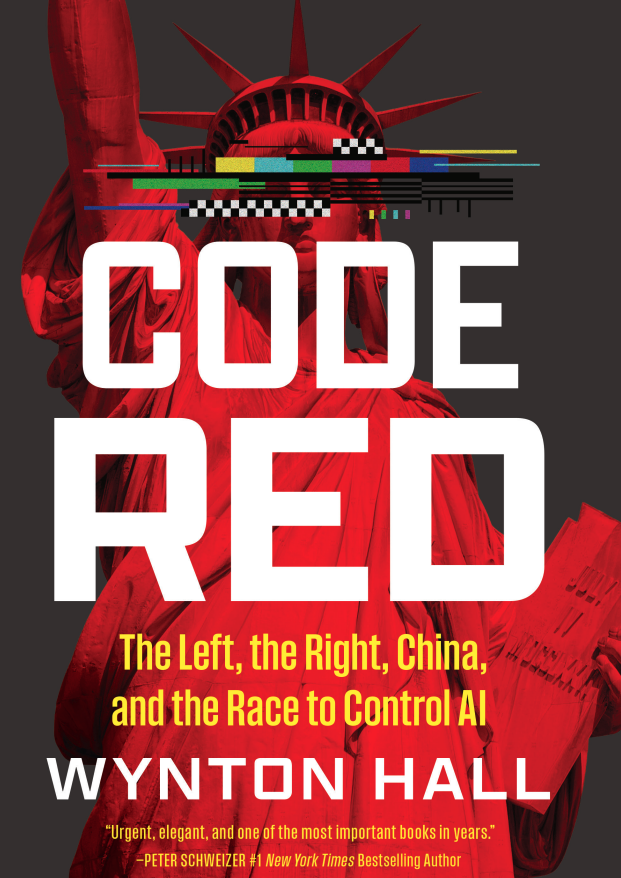

Il direttore dei social media di Breitbart News, Wynton Hall, espone i pericoli della tecnologia dell’intelligenza artificiale controllata dalla sinistra della Silicon Valley ostile non solo al movimento MAGA, ma all’America in generale, e come i conservatori possono proteggere i loro familiari e il paese in generale da questa minaccia nel prossimo libro Codice Rosso: La Sinistra, la Destra, la Cina e la corsa al controllo dell’IA.

Descrizione ufficiale del libro di HarperCollins dice i contenuti del libro includeranno:

- Perché l’intelligenza artificiale è predisposta per l’indottrinamento del risveglio e come resistervi.

- Come le élite intendono sfruttare come arma le paure sulla perdita di posti di lavoro nell’intelligenza artificiale per aumentare la dipendenza.

- Come l’America può battere la Cina senza diventare Cina.

- Come preparare i tuoi figli alla velocità accecante dell’interruzione dell’intelligenza artificiale.

- Le nuove minacce alla sicurezza nazionale scatenate dall’intelligenza artificiale e il modo in cui ci difendiamo da esse.

- Perché le “fidanzate AI” attirano milioni di persone e cosa servirà per preservare un’autentica connessione umana.

- In che modo l’intelligenza artificiale metterà alla prova la fede e il significato e perché il rinnovamento spirituale potrebbe essere il suo risultato più sorprendente.

Lucas Nolan è un reporter di Breitbart News che si occupa di questioni di libertà di parola e censura online.