Un esperto di marketing ha rivelato venerdì che la piattaforma ChatGPT mostrava avvisi di sicurezza per i collegamenti a siti Web di raccolta fondi repubblicani mentre non mostrava avvisi simili per i siti di raccolta fondi democratici. OpenAI ha accusato la parzialità del suo sistema di intelligenza artificiale, oggetto del primo capitolo del nuovo libro CODICE ROSSO, per un “problema tecnico”.

IL New York Post rapporti che OpenAI ha annunciato venerdì che un “errore tecnico” ha causato la visualizzazione di avvisi di sicurezza sulla sua piattaforma ChatGPT per i collegamenti ai siti Web del Partito Repubblicano, senza mostrare avvisi simili per i siti di raccolta fondi democratici. Il problema è venuto alla luce quando gli utenti hanno scoperto che i collegamenti a WinRed, la piattaforma ufficiale di donazioni del Partito Repubblicano, venivano contrassegnati come potenzialmente non sicuri, mentre i collegamenti ad ActBlue, la principale piattaforma di raccolta fondi per la campagna democratica, non generavano avvisi simili.

Il marketing digitale Mike Morrison ha attirato per la prima volta l’attenzione sulla discrepanza quando ha pubblicato un post sulla sua scoperta su X. Morrison ha chiesto a ChatGPT di generare collegamenti per vari negozi di articoli per campagne politiche democratiche e repubblicane. Il sistema di intelligenza artificiale forniva collegamenti ai negozi GOP ospitati da WinRed, ma li accompagnava con un messaggio di avviso che chiedeva agli utenti di “verificare che questo collegamento sia sicuro”.

Il messaggio di avviso affermava inoltre che il collegamento non era stato verificato e poteva contenere dati della conversazione dell’utente che potevano essere condivisi con un sito di terze parti. Gli utenti sono stati avvisati di assicurarsi di fidarsi del collegamento prima di procedere. Nessun avviso di questo tipo è apparso quando Morrison ha fatto clic su un collegamento a un negozio gestito da ActBlue.

“WILD. ChatGPT segna universalmente [WinRed] collegamenti come potenzialmente non sicuri”, ha scritto Morrison nel suo post sui social media. “Ovviamente i collegamenti ActBlue sono assolutamente accettabili.”

OpenAI ha risposto rapidamente all’incidente, con un portavoce che ha affermato che la situazione non avrebbe dovuto verificarsi e che sarebbe stata affrontata. Kate Waters, parlando a nome di OpenAI, ha fornito una dichiarazione in cui spiega l’indagine della società sulla questione.

“Non appena abbiamo visto il post, abbiamo contattato l’individuo e abbiamo esaminato la questione”, ha detto Waters. Ha sottolineato che la questione non era legata a pregiudizi politici, affermando: “Non si trattava di politica di parte”.

Secondo Waters il problema tecnico derivava dal modo in cui il sistema elaborava alcuni collegamenti ai siti web. “Il modello ha generato alcuni collegamenti a siti Web che non erano ancora nel nostro indice di ricerca sia per WinRed che, in un caso, per ActBlue, e i nostri sistemi li hanno contrassegnati come generati dall’intelligenza artificiale come parte delle nostre misure di sicurezza standard”, ha spiegato. Waters ha confermato che la società sta lavorando per risolvere completamente il problema.

L’incidente ha suscitato una significativa reazione da parte di funzionari e sostenitori repubblicani sui social media. Ryan Lyk, CEO di WinRed, ha descritto la situazione in termini crudi quando ha pubblicato un post su X, affermando: “Questa è un’interferenza elettorale”.

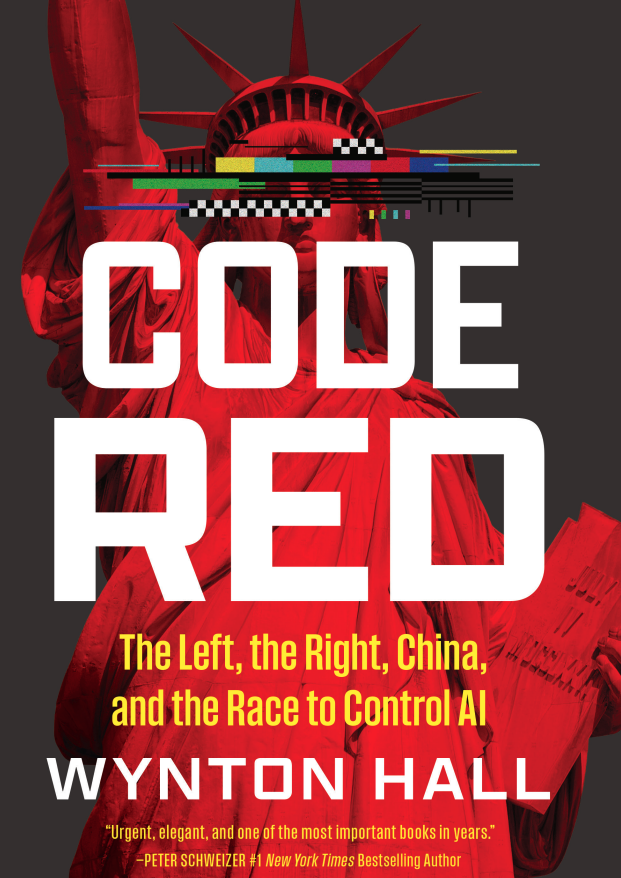

Il nuovo libro del direttore dei social media Wynton Hall di Breitbart News, Codice Rosso: La Sinistra, la Destra, la Cina e la corsa al controllo dell’IAspiega che lo schiacciante pregiudizio di sinistra della Silicon Valley è stato instillato in popolari piattaforme di intelligenza artificiale come ChatGPT. Spiega in modo definitivo come si verificano i bias dell’intelligenza artificiale e cosa possono fare i conservatori in modo che ChatGPT non segnali solo i link di raccolta fondi di una parte, o Google Gemini no. etichettare solo repubblicani di spicco come usando il presunto “incitamento all’odio”.

CODICE ROSSO copre una vasta gamma di argomenti relativi all’intelligenza artificiale, che vanno dal suo impatto sulle elezioni e sull’economia alla fede e alla famiglia. Fondamentalmente, il libro non tratta l’intelligenza artificiale come un male terribile o un bene utopico, ma piuttosto come uno strumento che deve essere sfruttato correttamente per sostenere i valori americani.

La senatrice Marsha Blackburn (R-TN), che lo era nominato uno di TEMPOelogiate le 100 persone più influenti nel campo dell’intelligenza artificiale CODICE ROSSO come una “lettura obbligata”. Ha aggiunto: “Pochi comprendono la nostra lotta conservatrice contro la Big Tech come fa Hall”, rendendolo “qualificato in modo univoco per esaminare come possiamo utilizzare al meglio l’enorme potenziale dell’intelligenza artificiale, garantendo al tempo stesso che non sfrutti bambini, creatori e conservatori”. Il pluripremiato giornalista investigativo e fondatore di Public Michael Shellenberger chiama CODICE ROSSO “illuminante”, “allarmante” e descrive il libro come “un essenziale punto di partenza per coloro che sperano di sovvertire i piani autocratici delle Big Tech prima che sia troppo tardi”.

Leggi di più su IL New York Post Qui.

Lucas Nolan è un reporter di Breitbart News che si occupa di questioni di libertà di parola e censura online.