Anthropic ha intentato una causa contro l’amministrazione Trump cercando di ribaltare una lista nera del Pentagono che designava l’azienda come un rischio per la sicurezza nazionale nella catena di approvvigionamento. I dipendenti di OpenAI e Google si sono affrettati a sostenere la startup AI di Dario Amodei.

CNBC rapporti che Anthropic ha intentato un’azione legale lunedì presso il tribunale distrettuale degli Stati Uniti per il distretto settentrionale della California, contestando ciò che la società descrive come azioni illegali e senza precedenti che stanno causando danni irreparabili alle sue operazioni commerciali. La causa rappresenta l’ultimo sviluppo in a controversia controversa tra la startup dell’intelligenza artificiale e l’amministrazione Trump sull’uso della tecnologia dell’azienda in applicazioni militari.

La denuncia della società afferma che i contratti del governo federale sono già in fase di risoluzione, mentre sia gli accordi attuali che quelli futuri del settore privato sono incerti. Secondo il documento, queste azioni mettono a repentaglio centinaia di milioni di dollari di entrate a breve termine. Il CFO di Anthropic Krishna Rao ha fornito ulteriore contesto in un documento correlato, suggerendo che l’impatto finanziario potrebbe essere molto più sostanziale. “Nell’intero business di Anthropic, e tenendo conto della probabilità che un dato cliente effettui una lettura massima, le azioni del governo potrebbero ridurre le entrate di Anthropic nel 2026 di diversi miliardi di dollari”, ha affermato Rao.

La designazione del rischio di catena di fornitura, confermata ufficialmente la scorsa settimana, rappresenta una misura straordinaria storicamente riservata agli avversari stranieri. Secondo questa classificazione, i fornitori e gli appaltatori della difesa devono certificare di non utilizzare i modelli di intelligenza artificiale di Anthropic, noti come Claude, in qualsiasi lavoro svolto per il Pentagono. Questo requisito impedisce di fatto alla società di partecipare a contratti e progetti legati alla difesa.

Il presidente Donald Trump amplificato la posizione assunta dall’amministrazione attraverso i social media il mese scorso, ordinando alle agenzie federali di cessare immediatamente ogni utilizzo della tecnologia di Anthropic. “Noi decideremo il destino del nostro Paese – NON una società di intelligenza artificiale della sinistra radicale fuori controllo, gestita da persone che non hanno idea di cosa sia il mondo reale”, ha scritto Trump.

Il conflitto tra Anthropic e il Dipartimento della Guerra deriva da disaccordi sui casi d’uso accettabili per i modelli di intelligenza artificiale dell’azienda. Anthropic aveva firmato un contratto da 200 milioni di dollari con il Pentagono a luglio ed è diventato il primo laboratorio di intelligenza artificiale a distribuire la sua tecnologia attraverso le reti riservate dell’agenzia. Tuttavia, i negoziati sui termini futuri del contratto sono arrivati ad un punto morto a causa di disaccordi fondamentali sulle applicazioni ammissibili.

Prima di questa disputa pubblica, Anthropic era un partner importante in numerose agenzie federali mentre il governo lavorava per modernizzare i propri sistemi e le proprie capacità con la tecnologia AI avanzata. L’improvvisa designazione dell’azienda come rischio per la sicurezza segna una drammatica inversione di tendenza in questo rapporto.

Nella sua documentazione legale, Anthropic ha richiesto al tribunale di annullare la designazione di rischio della catena di fornitura e di sospendere l’azione mentre il caso procede. La società ha sottolineato che, oltre ai danni economici immediati, la sua reputazione e le libertà del Primo Emendamento sono sotto attacco. “In assenza di un provvedimento giudiziario, tali danni non potranno che aggravarsi nelle settimane e nei mesi a venire”, si legge nella denuncia.

Inoltre, Anthropic ha presentato istanza di revisione formale della decisione del Dipartimento della Guerra presso la Corte d’Appello degli Stati Uniti a Washington DC, perseguendo molteplici vie legali contemporaneamente.

Lunedì un portavoce di Anthropic ha affrontato il contenzioso, affermando: “La richiesta di controllo giurisdizionale non cambia il nostro impegno di lunga data nello sfruttare l’intelligenza artificiale per proteggere la nostra sicurezza nazionale, ma questo è un passo necessario per proteggere la nostra attività, i nostri clienti e i nostri partner. Continueremo a perseguire ogni percorso verso la risoluzione, compreso il dialogo con il governo”.

Più di una dozzina di agenzie federali sono citate come imputate nella causa, tra cui il Dipartimento della Guerra, il Dipartimento del Tesoro, il Dipartimento di Stato e l’Amministrazione dei Servizi Generali.

TechCrunch rapporti che OpenAI e i datori di lavoro di Google sostengono la causa di Anthropic:

Lunedì più di 30 dipendenti di OpenAI e Google DeepMind hanno presentato una dichiarazione a sostegno di Anthropic causa contro il Dipartimento della Difesa degli Stati Uniti dopo che l’agenzia federale ha etichettato l’azienda di intelligenza artificiale come un rischio per la catena di fornitura, secondo i documenti depositati in tribunale.

“La designazione di Anthropic da parte del governo come rischio per la catena di approvvigionamento è stato un uso improprio e arbitrario del potere che ha gravi conseguenze per il nostro settore”, si legge nella nota, i cui firmatari includono Jeff Dean, capo scienziato di Google DeepMind.

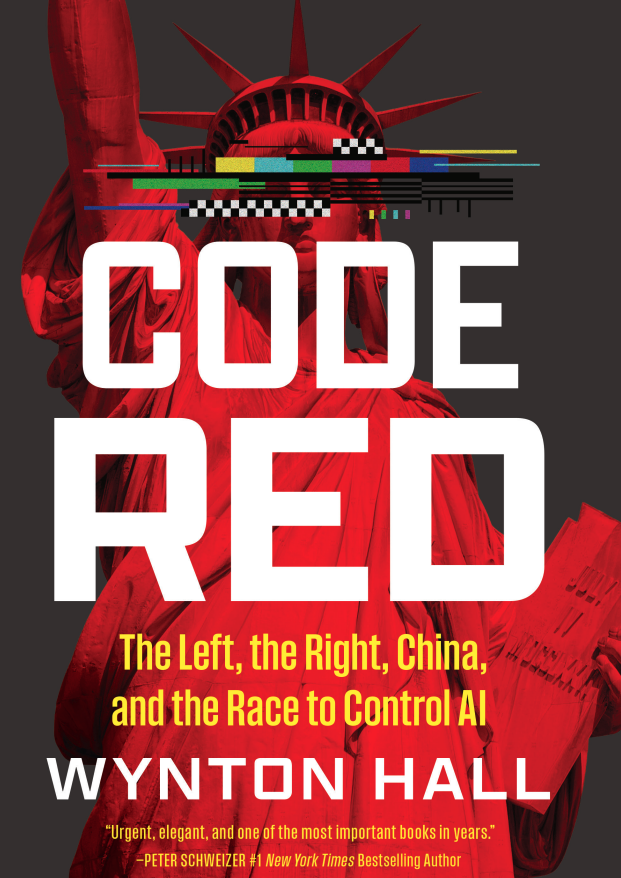

Mentre le aziende di intelligenza artificiale, guidate e costruite da persone di sinistra con una storia di attacchi a Donald Trump e al movimento MAGA, continuano a combattere tra loro per vincere le guerre dell’intelligenza artificiale, le ricadute potrebbero avere un impatto su tutto, dalla posizione di difesa americana e dalle elezioni all’economia e alla salute mentale dei nostri figli e nipoti. Il direttore dei social media di Breitbart News, Wynton Hall, ha scritto il suo prossimo libro, libro Codice Rosso: La Sinistra, la Destra, la Cina e la corsa al controllo dell’IAper fungere da guida definitiva su come il movimento MAGA può creare posizioni sull’intelligenza artificiale a beneficio dell’umanità senza cedere il controllo della nostra nazione alla sinistra della Silicon Valley o permettere ai cinesi di conquistare il mondo.

La senatrice Marsha Blackburn (R-TN), che lo era nominato uno di TEMPOelogiate le 100 persone più influenti nel campo dell’intelligenza artificiale Codice Rosso come una “lettura obbligata”. Ha aggiunto: “Pochi comprendono la nostra lotta conservatrice contro la Big Tech come fa Hall”, rendendolo “qualificato in modo univoco per esaminare come possiamo utilizzare al meglio l’enorme potenziale dell’intelligenza artificiale, garantendo al tempo stesso che non sfrutti bambini, creatori e conservatori”. Il pluripremiato giornalista investigativo e fondatore di Public Michael Shellenberger chiama Codice Rosso “illuminante”, “allarmante” e descrive il libro come “un essenziale punto di partenza per coloro che sperano di sovvertire i piani autocratici delle Big Tech prima che sia troppo tardi”.

Leggi di più su CNBC qui.

Lucas Nolan è un reporter di Breitbart News che si occupa di questioni di libertà di parola e censura online.