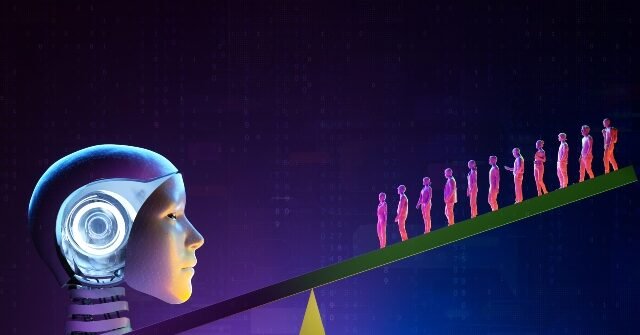

Un gruppo di candidati a un posto di lavoro ha intentato una causa sostenendo che gli strumenti di screening dell’intelligenza artificiale utilizzati nelle assunzioni dovrebbero essere soggetti agli stessi requisiti di divulgazione delle agenzie di segnalazione del credito. Proprio come le agenzie di credito devono dare ai consumatori la possibilità di contestare informazioni inesatte, la causa afferma che le persone in cerca di lavoro dovrebbero avere il diritto di correggere il software di screening basato sull’intelligenza artificiale.

IL New York Times rapporti che una causa intentata in California prende di mira il crescente utilizzo dell’intelligenza artificiale nello screening dell’occupazione, sostenendo che i sistemi di assunzione dell’intelligenza artificiale dovrebbero essere regolati dalle stesse leggi sulla protezione dei consumatori che regolano le agenzie di credito. Il caso, depositato presso la Corte superiore della contea di Contra Costa, rappresenta ciò che gli esperti legali prevedono sarà un numero crescente di sfide alle pratiche di assunzione guidate dall’intelligenza artificiale.

La causa prende di mira Eightfold AI, una società con sede a Santa Clara che fornisce tecnologia di screening ai datori di lavoro. Secondo la denuncia, Eightfold ha assemblato un enorme database contenente informazioni su oltre un miliardo di lavoratori in tutto il mondo, inclusi oltre un milione di titoli professionali e un milione di competenze compilati da fonti come LinkedIn. Il software dell’azienda valuta i candidati al lavoro confrontando le loro qualifiche con i requisiti del datore di lavoro e assegna loro punteggi su una scala da uno a cinque.

Erin Kistler, una delle ricorrenti nel caso, è laureata in informatica e vanta decenni di esperienza nel settore tecnologico. Nonostante le sue qualifiche, nell’ultimo anno ha riscontrato scarsi risultati nella ricerca di lavoro. Secondo i suoi dati dettagliati, solo lo 0,3% delle migliaia di domande presentate ha dato luogo a contatti o colloqui successivi. Molteplici domande sono state elaborate tramite il sistema Eightfold. Kistler ha espresso frustrazione per la mancanza di trasparenza, affermando che crede di meritare di sapere quali informazioni vengono raccolte su di lei e condivise con potenziali datori di lavoro.

L’argomento legale è incentrato sul Fair Credit Reporting Act, una legislazione approvata dal Congresso nel 1970 quando le agenzie di credito iniziarono a utilizzare database informatici per compilare informazioni sui consumatori e generare punteggi numerici. La legge impone alle agenzie di segnalazione di divulgare informazioni ai consumatori e di fornire meccanismi per contestare le inesattezze. Sebbene la legge sia comunemente associata al reporting creditizio, il suo campo di applicazione si estende oltre i servizi finanziari. Lo statuto definisce in generale un rapporto sul consumatore come qualsiasi raccolta di informazioni sulle caratteristiche personali utilizzate per determinare l’idoneità per vari scopi, compreso in particolare l’occupazione.

Le persone in cerca di lavoro descrivono il processo di screening dell’intelligenza artificiale come un custode algoritmico che può impedire ai candidati di raggiungere i responsabili delle assunzioni umani senza fornire alcun feedback sui punteggi o sulla metodologia utilizzata per generare valutazioni. Senza accesso a queste informazioni, i candidati affermano di non avere la capacità di identificare o correggere potenziali errori nelle loro valutazioni.

Questo caso rappresenta un approccio a quelle che i professionisti legali si aspettano saranno numerose sfide per gli strumenti di occupazione basati sull’intelligenza artificiale. Altre cause legali si sono concentrate su presunte violazioni delle leggi antidiscriminazione. Un importante caso del 2023 contro Workday sostiene che il sistema di screening dell’azienda discrimina illegalmente le persone anziane in cerca di lavoro e le persone con disabilità.

Il giudice Rita F. Lin ha negato la mozione di Workday di archiviare il caso, ritenendo che i querelanti presentassero prove plausibili che suggerivano che gli strumenti algoritmici dell’azienda rifiutano in modo sproporzionato i candidati sulla base di fattori non correlati alle qualifiche. La sua decisione citava prove tra cui un avviso di rifiuto ricevuto da un richiedente all’1:50 di notte, meno di un’ora dopo la presentazione della domanda. A maggio, il giudice ha concesso l’approvazione preliminare affinché il caso procedesse come un’azione collettiva che potenzialmente comprenderebbe milioni di candidati respinti. Workday sostiene che le accuse sono false e afferma che i suoi strumenti di reclutamento basati sull’intelligenza artificiale non sono addestrati per identificare o utilizzare caratteristiche protette come razza, età o disabilità.

Il panorama normativo che circonda queste questioni è cambiato sotto diverse amministrazioni. Nel 2024, il Consumer Financial Protection Bureau ha emesso linee guida affermando che i dossier e i punteggi creati a fini di assunzione rientrano nella giurisdizione del Fair Credit Reporting Act e che i fornitori che li creano si qualificano legalmente come agenzie di segnalazione dei consumatori. Tali documenti guida segnalano alle aziende come le autorità di regolamentazione intendono far valere la propria autorità di vigilanza.

Jenny Yang, ex presidente della Commissione per le pari opportunità di lavoro nominata durante l’amministrazione Obama e che attualmente rappresenta i querelanti, ha osservato che la commissione ha iniziato a esaminare i sistemi di assunzione algoritmici più di dieci anni fa. La commissione ha riconosciuto che questi sistemi stavano trasformando radicalmente i processi di assunzione, con i candidati che ricevevano rifiuti durante le ore notturne senza spiegazione.

Leggi di più su IL New York Times Qui.

Lucas Nolan è un reporter di Breitbart News che si occupa di questioni di libertà di parola e censura online.