Di MATTHEW PERRONE, Associated Press

WASHINGTON – Con centinaia di milioni di persone che si rivolgono ai chatbot per chiedere consiglio, era solo questione di tempo prima che le aziende tecnologiche iniziassero a offrire programmi specificamente progettati per rispondere a domande sulla salute.

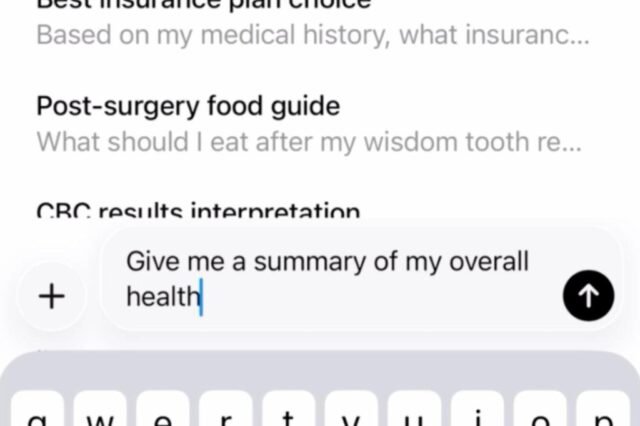

A gennaio, OpenAI ha introdotto ChatGPT Health, una nuova versione del suo chatbot che, secondo la società, può analizzare le cartelle cliniche degli utenti, le app per il benessere e i dati dei dispositivi indossabili per rispondere a domande mediche e sanitarie. Attualmente c’è una lista d’attesa per il programma. Anthropic, una società rivale di intelligenza artificiale, offre funzionalità simili per alcuni utenti del suo chatbot Claude.

Entrambe le società affermano che i loro programmi, noti come modelli linguistici di grandi dimensioni, non sostituiscono l’assistenza professionale e non dovrebbero essere utilizzati per diagnosticare condizioni mediche. Invece, dicono che i chatbot possono riassumere e spiegare risultati di test complicati, aiutare a prepararsi per una visita dal medico o analizzare importanti tendenze sanitarie sepolte nelle cartelle cliniche e nelle metriche delle app.

Ecco alcune cose da considerare prima di parlare con un chatbot della tua salute:

I chatbot possono offrire informazioni più personalizzate rispetto a una ricerca su Google

Alcuni medici e ricercatori che hanno lavorato con ChatGPT Health e programmi simili li vedono come un miglioramento rispetto allo status quo.

Le piattaforme di intelligenza artificiale non sono perfette – a volte possono avere allucinazioni o fornire cattivi consigli – ma è più probabile che le informazioni che producono siano personalizzate e specifiche rispetto a quelle che i pazienti potrebbero trovare tramite una ricerca su Google.

“L’alternativa spesso è niente, o il paziente che la sfrutta”, ha affermato il dottor Robert Wachter, esperto di tecnologia medica presso l’Università della California, a San Francisco. “E quindi penso che se usi questi strumenti in modo responsabile, penso che puoi ottenere informazioni utili”.

Un vantaggio degli ultimi chatbot è che rispondono alle domande degli utenti con il contesto della loro storia medica, comprese prescrizioni, età e note mediche.

Anche se non hai concesso all’IA l’accesso alle tue informazioni mediche, Wachter e altri consigliano di fornire ai chatbot quanti più dettagli possibili per migliorare le risposte.

Se hai sintomi preoccupanti, salta l’IA

Wachter e altri sottolineano che ci sono situazioni in cui le persone dovrebbero saltare il chatbot e rivolgersi immediatamente a un medico. Sintomi come mancanza di respiro, dolore al petto o un forte mal di testa potrebbero segnalare un’emergenza medica.

Anche in situazioni meno urgenti, pazienti e medici dovrebbero avvicinarsi ai programmi di intelligenza artificiale con “un certo grado di sano scetticismo”, ha affermato il dottor Lloyd Minor della Stanford University.

“Se stai parlando di una decisione medica importante, o anche di una decisione più piccola riguardante la tua salute, non dovresti mai fare affidamento solo su ciò che ottieni da un ampio modello linguistico”, ha detto Minor, che è il preside della facoltà di medicina di Stanford.

Considera la tua privacy prima di caricare qualsiasi dato sanitario

Molti vantaggi offerti dai robot IA derivano dalla condivisione da parte degli utenti di informazioni mediche personali. Ma è importante capire che qualsiasi cosa condivisa con un’azienda di intelligenza artificiale non è protetta dalla legge federale sulla privacy che normalmente regola le informazioni mediche sensibili.

Comunemente nota come HIPAA, la legge prevede multe e persino il carcere per medici, ospedali, assicuratori o altri servizi sanitari che divulgano cartelle cliniche. Ma la legge non si applica alle aziende che progettano chatbot.

“Quando qualcuno carica la propria cartella clinica in un modello linguistico di grandi dimensioni, è molto diverso dal consegnarla a un nuovo medico”, ha affermato Minor. “I consumatori devono capire che gli standard sulla privacy sono completamente diversi.”

Sia OpenAI che Anthropic affermano che le informazioni sanitarie degli utenti sono tenute separate da altri tipi di dati e sono soggette a ulteriori tutele della privacy. Le aziende non utilizzano i dati sanitari per addestrare i propri modelli. Gli utenti devono acconsentire alla condivisione delle proprie informazioni e possono disconnettersi in qualsiasi momento.

I test dimostrano che i chatbot possono inciampare

Nonostante l’entusiasmo che circonda l’intelligenza artificiale, i test indipendenti della tecnologia sono agli inizi. I primi studi suggeriscono che programmi come ChatGPT possono superare esami medici di alto livello ma spesso inciampano quando interagiscono con gli esseri umani.

Uno studio condotto da 1.300 partecipanti dall’Università di Oxford ha recentemente scoperto che le persone che utilizzano chatbot basati sull’intelligenza artificiale per ricercare ipotetiche condizioni di salute non prendono decisioni migliori rispetto alle persone che utilizzano ricerche online o giudizi personali.

I chatbot con intelligenza artificiale presentati con scenari medici in forma scritta e completa hanno identificato correttamente la condizione sottostante nel 95% dei casi.

“Non era questo il problema”, ha detto l’autore principale Adam Mahdi dell’Oxford Internet Institute. “Il momento in cui le cose sono andate in pezzi è stato durante l’interazione con i partecipanti reali”.

Mahdi e il suo team hanno riscontrato diversi problemi di comunicazione. Spesso le persone non forniscono ai chatbot le informazioni necessarie per identificare correttamente il problema di salute. Al contrario, i sistemi di intelligenza artificiale spesso rispondevano con una combinazione di informazioni buone e cattive e gli utenti avevano difficoltà a distinguere tra le due.

Lo studio, condotto nel 2024, non ha utilizzato le ultime versioni dei chatbot, comprese le nuove offerte come ChatGPT Health.

Una seconda opinione dell’IA può essere utile

La capacità dei chatbot di porre domande di follow-up e di ottenere dettagli chiave dagli utenti è un’area in cui Wachter vede margini di miglioramento.

“Penso che sarà allora che tutto diventerà davvero valido, quando gli strumenti diventeranno un po’ più medici nel modo in cui vanno avanti e indietro” con i pazienti, ha detto Wachter.

Per ora, un modo per sentirti più sicuro delle informazioni che stai ricevendo è consultare più chatbot, in modo simile a ottenere una seconda opinione da un altro medico.

“A volte inserisco informazioni in ChatGPT e informazioni in Gemini”, ha detto Wachter, riferendosi allo strumento AI di Google. “E quando entrambi sono d’accordo, mi sento un po’ più sicuro che questa sia la risposta giusta.”

___

Il Dipartimento Salute e Scienza dell’Associated Press riceve il sostegno del Dipartimento di Educazione Scientifica dell’Howard Hughes Medical Institute e della Robert Wood Johnson Foundation. L’AP è l’unico responsabile di tutti i contenuti.