L’arrivo dell’intelligenza artificiale ha già avuto un impatto trasformativo sulla società e gli esperti dicono che è solo l’inizio. Ma con il progresso arriva anche un inevitabile svantaggio, poiché la rivoluzione tecnologica minaccia qualcosa che gli americani hanno a lungo apprezzato e difeso con fierezza: la privacy.

Diversi recenti incidenti di alto profilo sottolineano l’intersezione instabile in cui il progresso digitale e la privacy ora si scontrano.

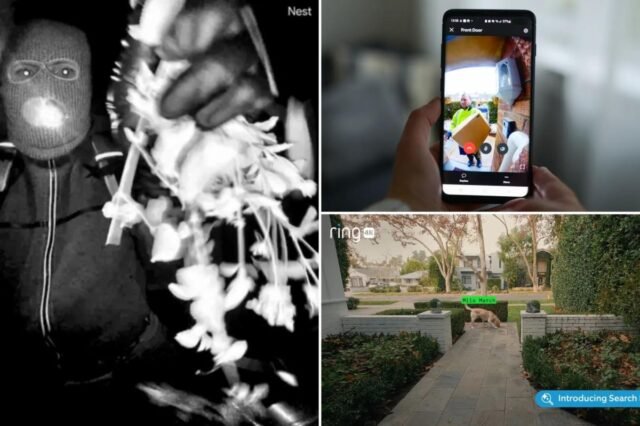

Ring, l’azienda produttrice di videocamere per campanelli di proprietà di Amazon, dovette affrontare un enorme contraccolpo dopo la disastrosa pubblicità del Super Bowl, che avrebbe dovuto essere una celebrazione della tecnologia dell’azienda responsabile del tracciamento e del ritrovamento di un cane smarrito. Invece, ha suscitato indignazione da parte degli spettatori e dei difensori della privacy che lo hanno visto come un presagio di una rete di sorveglianza basata sull’intelligenza artificiale che potrebbe essere sfruttata dalle forze dell’ordine e dagli interessi aziendali.

L’amministratore delegato dell’azienda si è ritrovato a scusarsi per la vasta rete di telecamere di Ring e le sue capacità, anche se il monitoraggio di case e quartieri rappresenta il suo intero modello di business.

Di conseguenza, Ring ha annullato la sua partnership con Flock Safetyun’azienda di software di sicurezza che vende tecnologia di scansione delle targhe alle forze dell’ordine.

Nel frattempo, OpenAI, la società dietro ChatGPT, è stata criticata dopo che è stato rivelato che i dipendenti avevano bandito gli accusati Sparatutto in una scuola canadese Il resoconto di Jesse Van Rootselaar su messaggi inquietanti, ma non ha mai allertato la polizia.

Le telecamere del campanello non tengono d’occhio solo i pirati del portico; possono sorprendere il tuo vicino mentre taglia il prato o cammina a passo veloce davanti alla tua casa, o fungere da cane da guardia del vicinato.

I chatbot con intelligenza artificiale forniscono risposte a qualsiasi domanda tu abbia in un istante e tutti i dati personali finiscono in una server farm da qualche parte.

L’idea di vendita è la tranquillità, ma il costo effettivo, ovvero la tua privacy, potrebbe essere maggiore di quanto desideri pagare.

“Questo è davvero terrificante per me”, afferma Matt Sailor, CEO della società di soluzioni di sorveglianza IC Realtime. “Consentirai alle aziende di utilizzare i dati che vengono registrati e archiviati da casa tua con la tua famiglia coinvolta, senza preoccuparsi dell’argomento, e lo farai con il pretesto di, ‘oh, lo stiamo facendo per salvare Fido.’ È semplicemente sbagliato.

“Siamo decisamente in una fase in cui dobbiamo iniziare a ridefinire le nostre aspettative su ciò che è privato”, aggiunge Michel Paradis, un avvocato che tiene un corso alla Columbia University sulla legge sull’intelligenza artificiale.

“E dobbiamo anche essere molto cauti.”

Sulla carta, gli americani non sono mai stati così protetti.

In pratica, dicono gli esperti, il sistema è uno scherzo.

“In questo momento le leggi che abbiamo riguardano essenzialmente la gestione di una connessione dial-up in un mondo 5G”, afferma Paul Armstrong, consulente tecnologico e fondatore di TBD Group.

Meta recentemente ha pagato una multa di 725 milioni di dollari per risolvere le accuse di violazione della privacy, ma per un’azienda così grande questo è semplicemente il costo per fare affari.

“Mendute come questa sono come affermazioni per queste grandi aziende tecnologiche”, afferma Sree Sreenivasan, CEO di Digi Mentors. “Ciò dimostra loro che sono sulla strada giusta con tutte queste cose.”

“Una multa a nove cifre sembra enorme finché non ti rendi conto che il numero sembra un errore di arrotondamento in una chiamata sugli utili trimestrali”, aggiunge Armstrong.

Peter Jackson, avvocato specializzato in sicurezza informatica e privacy presso Greenberg Glusker a Los Angeles, afferma che la maggior parte dei consumatori non ha idea di quanto siano realmente esposti.

“I consumatori sono poco informati su ciò che accade con le loro informazioni”, afferma. “Le informative (sulla privacy) sono tecnicamente approfondite e praticamente inutili. La maggior parte delle persone non capisce veramente cosa significhi.”

Jackson concorda sul fatto che le sanzioni attuali non soddisfano il momento.

Indica un caso recente in cui la Walt Disney Co. ha accettato pagare 2,75 milioni di dollari per risolvere le accuse di aver violato le leggi sulla privacy dei consumatori della California.

Il colosso dell’intrattenimento è stato accusato di non aver rispettato pienamente le richieste degli utenti di rinunciare alla condivisione dei dati sui servizi di streaming Disney.

La multa è un record ai sensi della legge sulla privacy della California, ma come nota Jackson, “Quell’importo non è niente per la Disney. La legge sulla privacy degli Stati Uniti non è sufficientemente armata di sanzioni abbastanza severe da incentivare le aziende a fare meglio.”

“L’erosione della privacy non è un bug, ma una caratteristica del modello di business della maggior parte delle aziende tecnologiche”, afferma Arash Vakil, professore di economia alla CUNY e consulente di prodotto.

“Queste aziende che hanno un modello di abbonamento integrato saranno in grado di avere una migliore opportunità di massimizzare le entrate degli azionisti e il valore per gli azionisti”.

“La realtà è che queste aziende vivono di dati”, aggiunge Sailor.

“Vivono delle informazioni che fornisci loro. Raccolgono una quantità incredibile di informazioni dalle tue abitudini quotidiane e i tuoi dati non sono realmente tuoi dati. Sono di proprietà delle aziende.”

A giudicare dalla popolarità delle videocamere per campanelli e dei motori di intelligenza artificiale, i consumatori sembrano essere d’accordo con questo risultato. “Le persone sono davvero pigre e scelgono sempre la via più semplice”, afferma Sailor.

Molti sono rimasti confusi quando l’FBI è riuscita a recuperare il filmato della Nest Cam della notte in cui Nancy Guthrie, la madre della co-conduttrice di “Today” Savannah Guthrie, è stata apparentemente rapita dalla sua casa di Tucson, in Arizona, dopo che le forze dell’ordine hanno dichiarato che i dati erano inaccessibili perché la famiglia non aveva un abbonamento pagato.

Giorni dopo, il direttore dell’FBI Kash Patel ha affermato che il video della casa è stato “recuperato da dati residui situati nei sistemi back-end”.

Google, la società madre di Nest, non ha l’obbligo di conservare tali dati se l’utente ha un abbonamento e ad un certo punto potrebbero essere sovrascritti, anche se no, non è chiaro quando ciò accada in genere. L’informativa sulla privacy dell’azienda rileva che il video scade dopo tre ore.

Jaron Mink, assistente professore di informatica e ingegneria presso l’Arizona State University, sottolinea che gli Stati Uniti hanno norme lassiste sulla privacy, secondo NPR.

“A volte significa che è più difficile che la funzionalità di eliminazione dei dati venga effettivamente implementata, perché non è stata concepita come requisito nel sistema in mente”, ha affermato Mink.

Sebbene Google abbia negato di incorporare video degli utenti Nest utilizzati per addestrare modelli di intelligenza artificiale, secondo Ars Technicaha affermato: “Potremmo utilizzare i tuoi input, inclusi suggerimenti e feedback, utilizzo e output dalle interazioni con le funzionalità di intelligenza artificiale per ulteriori ricerche, messa a punto e formazione dei modelli generativi di Google, delle tecnologie di apprendimento automatico e dei prodotti e servizi correlati”.

Sreenivasan, ex chief digital officer di New York City, afferma che la maggior parte degli americani ha fatto pace con la barattazione della privacy con la comodità e il senso di sicurezza.

“Assolutamente, è quello che è successo. Le persone hanno questo strano rapporto con la tecnologia”, dice.

“Vogliono tutta la comodità e tutta la privacy, ma non fanno nulla per la privacy e fanno tutto per la comodità.”

Il modello è iniziato molto prima dell’intelligenza artificiale, con i cookie, quei piccoli file di testo archiviati dai siti Web per ricordare il tuo login e le tue preferenze.

“Quando i biscotti sono arrivati per la prima volta, gli americani dicevano: ‘Sì, qualunque cosa’”, dice Sreenivasan. “Avevi accettato tutto e non ti importava, perché volevi la comodità. Se smettessi di accettare i cookie, non ricorderebbe il tuo account, non ricorderebbe i tuoi preferiti, non ricorderebbe la tua cronologia. Renderebbe lo shopping online un’esperienza terribile.”

Poi è arrivato Gmail nel 2005promettendo “messaggi illimitati, senza dover eliminare nulla”, ricorda Sreenivasan. “Ci siamo resi conto immediatamente che stavano scansionando le tue e-mail e fornendo annunci pubblicitari. Se mia moglie mi avesse scritto: ‘Tesoro, puoi prendere un po’ di latte?’ Riceverei una pubblicità per Gristedes.”

Vakil vede lo stesso schema ora con AI, fotocamere e app. “Gli utenti o i consumatori hanno scambiato molto volentieri materiale gratuito con i loro dati”, afferma. “Ci siamo abituati alla comodità offerta da questa tecnologia… ma devi ricordare: se il prodotto è gratuito, allora il prodotto sei tu.”

Ma altri pensano che i consumatori siano in una posizione impossibile. “Alle persone non è mai stata data la possibilità di scegliere se accettare questi termini o non utilizzare il prodotto”, afferma Armstrong. “Opting-out significa sempre più rinunciare alla vita moderna”.

La tecnologia crea sempre nuove opportunità per le invasioni della privacy.

Ciò che rende un chatbot AI diverso da Google è che non si limita a sputare collegamenti; risponde. “I chatbot basati sull’intelligenza artificiale hanno una sorta di personalità che li fa sentire molto più come dei confidenti”, afferma Paradis. “C’è una personalità lì che guida queste risposte.”

Quella “intimità dell’esperienza dei chatbot”, dice, “solleva molte domande sulla privacy… e su come ciò che le persone chiedono ai chatbot con intelligenza artificiale può essere potenzialmente usato contro di loro, sia dalle forze dell’ordine che anche solo socialmente”.

Ha tutte le caratteristiche di una relazione confidenziale, tranne che non lo è. “Legalmente, non c’è alcun motivo per cui tutto ciò che inserisci in un chatbot debba essere considerato diverso dal tipo di informazioni che daresti a una banca”, afferma Paradis, sottolineando che le banche possono essere costrette da un’ordinanza del tribunale a consegnare i dati dei clienti.

Quale responsabilità hanno le aziende tecnologiche quando i loro strumenti si scontrano con la violenza del mondo reale? Sulla scia della sparatoria del 10 febbraio nella Columbia Britannica, OpenAI si è impegnata a rivedere i suoi protocolli di sicurezza. Ma misure più proattive rischierebbero un incubo diverso: un mondo di “Minority Report” in cui le persone vengono punite per quello che fanno Potrebbe Fare?

“La situazione del ChatGPT con l’attentatore canadese espone uno scenario senza possibilità di vittoria per il quale nessuno ha ancora legiferato”, afferma Armstrong.

“Non denunciare significa complicità, ma denunciare significa costruire un apparato di sorveglianza capace di segnalare qualcuno per un solo pensiero”.

Paradis concorda sul fatto che si tratta di una zona grigia dal punto di vista legale.

“Agli albori di Google, le persone chiedevano se Google avrebbe dovuto denunciare alla polizia se eri insolitamente interessato all’ISIS in base alla cronologia delle ricerche”, osserva. “Con l’intelligenza artificiale, non stai solo cercando come acquistare un silenziatore. Le stai chiedendo di spiegare come usarlo e come installarlo.”

Non aspettatevi nemmeno che i legislatori di Washington risolvano la questione.

“Certamente a livello federale, penso che sarà molto improbabile”, dice Paradis a proposito di una legislazione più severa sull’IA.

Nei prossimi anni, si aspetta che la maggior parte delle azioni concrete avvengano a livello statale. L’amministrazione Trump ha adottato “una visione generalmente libertaria”, osserva, spingendo anche le agenzie tramite ordini esecutivi a cercare modi per anticipare le normative statali sull’intelligenza artificiale.

“Siamo una specie di selvaggio West digitale”, afferma Jackson. “Il nostro sistema legale allo stato attuale non è costruito per combattere tali battaglie”.

Paradis è cautamente ottimista sul fatto che alla fine ci adatteremo, come abbiamo fatto con le tecnologie dirompenti del passato. “Questa non è la prima grande tecnologia che ha creato enormi disagi al nostro senso di privacy”, dice, indicando telecamere e radio, una volta viste come terrificanti. “Siamo diventati più intelligenti al riguardo. E penso che la stessa cosa accadrà ora.”