Tre ragazze adolescenti hanno intentato un’azione legale contro la società di intelligenza artificiale xAI di Elon Musk, sostenendo che il suo generatore di immagini Grok è stato utilizzato per creare e distribuire materiale pedopornografico con le loro sembianze.

IL Custode rapporti che la causa, intentata lunedì in California dove ha sede xAI, rappresenta la prima azione legale intentata da minorenni in risposta a preoccupazioni diffuse sulla generazione di immagini di nudo non consensuali di Grok all’inizio di quest’anno. I tre querelanti, due dei quali minorenni, provengono dal Tennessee e affermano che le loro fotografie sono state utilizzate a loro insaputa o senza il loro consenso per produrre contenuti sessualizzati generati dall’intelligenza artificiale.

Secondo la denuncia, le ragazze adolescenti hanno scoperto che immagini deepfake di loro stesse nude e alterate dall’intelligenza artificiale erano state caricate su un server Discord e condivise su varie piattaforme online. La scoperta è avvenuta quando una querelante, identificata nei documenti del tribunale come Jane Doe 1, ha ricevuto un messaggio su Instagram a dicembre da un utente anonimo. Il messaggio la avvisava che qualcuno nella sua cerchia sociale aveva caricato video e immagini deepfake su un server Discord che ritraevano lei e altre ragazze del suo liceo in posizioni nude e sessualizzate.

La denuncia afferma che Jane Doe 1 ha identificato tre immagini alterate dall’intelligenza artificiale che sembravano basate su fotografie scattate quando era minorenne, inclusa una della celebrazione del ritorno a casa della sua scuola. La denuncia descrive il contenuto in termini espliciti, affermando che le immagini mostravano il suo intero corpo, compresi i genitali, senza vestiti, e che un video la mostrava mentre si spogliava fino a diventare completamente nuda.

Le forze dell’ordine sono state allertate delle immagini e la polizia ha arrestato un sospetto alla fine del mese. Secondo quanto riferito, gli investigatori hanno trovato materiale pedopornografico sul telefono del sospettato, presumibilmente prodotto utilizzando la tecnologia di generazione di immagini e video di xAI. Gli investigatori criminali hanno anche scoperto che le immagini erano state condivise sull’app di messaggistica Telegram, dove sarebbero state utilizzate come forma di valuta per scambiare altra pornografia infantile.

Gli altri due ricorrenti hanno scoperto a febbraio che materiale simile che li riguardava era stato generato tramite l’intelligenza artificiale e distribuito online. La causa chiede il risarcimento dei danni contro xAI per danni alla reputazione e alla salute mentale derivanti dalla creazione e distribuzione di queste immagini.

Vanessa Baehr-Jones, avvocato che rappresenta i querelanti, ha dichiarato in una dichiarazione che “xAI ha scelto di trarre profitto dalla predazione sessuale di persone reali, compresi i bambini, nonostante conoscesse perfettamente le conseguenze della creazione di un prodotto così pericoloso”. La madre di una delle ragazze ha descritto l’impatto traumatico attraverso un rappresentante, dicendo: “Guardare mia figlia avere un attacco di panico dopo aver realizzato che queste immagini erano state create e distribuite senza alcuna speranza di ricordarle è stato straziante”.

La denuncia sostiene che il materiale pedopornografico è stato creato utilizzando un’applicazione di terze parti che ha concesso in licenza e si è basata sulla tecnologia di intelligenza artificiale di Grok per produrre immagini e video. Sebbene le immagini non siano state create direttamente sul sito Web di X o sull’app Grok, la causa sostiene che questo utilizzo richiede ancora i server di xAI e che xAI trae profitto dalla concessione in licenza della sua tecnologia a queste applicazioni. Gli avvocati dei ricorrenti accusano xAI di scaricare efficacemente la responsabilità attraverso la sua struttura di licenze e la mancanza di supervisione.

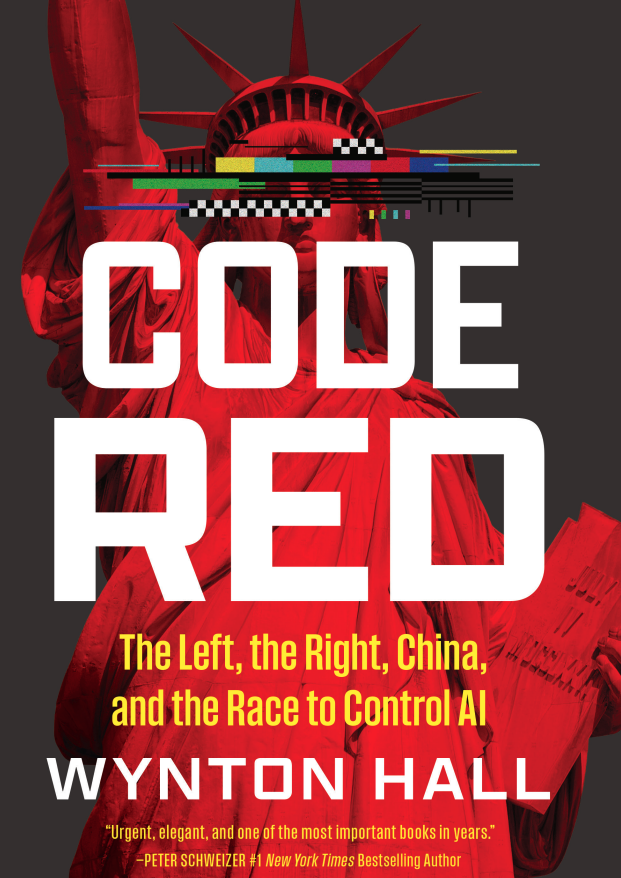

Il libro appena pubblicato di Wynton Hall, CODICE ROSSO, copre una vasta gamma di argomenti relativi all’intelligenza artificiale, che vanno dal suo impatto sulle elezioni e sull’economia alla fede e alla famiglia. Ciò include l’impatto che ha sui giovani americani, che va dagli impatti sulla salute mentale all’ascesa delle “fidanzate AI”. Il grave problema dell’intelligenza artificiale utilizzata per creare deepfake sessualizzati non consensuali è esattamente il motivo per cui i conservatori devono cogliere l’opportunità per creare politiche e tutele efficaci sull’intelligenza artificiale.

La senatrice Marsha Blackburn (R-TN), che lo era nominato uno di TEMPOelogiate le 100 persone più influenti nel campo dell’intelligenza artificiale Codice Rosso come una “lettura obbligata”. Ha aggiunto: “Pochi comprendono la nostra lotta conservatrice contro la Big Tech come fa Hall”, rendendolo “qualificato in modo univoco per esaminare come possiamo utilizzare al meglio l’enorme potenziale dell’intelligenza artificiale, garantendo al tempo stesso che non sfrutti bambini, creatori e conservatori”. Il pluripremiato giornalista investigativo e fondatore di Public Michael Shellenberger chiama Codice Rosso “illuminante”, “allarmante” e descrive il libro come “un essenziale punto di partenza per coloro che sperano di sovvertire i piani autocratici delle Big Tech prima che sia troppo tardi”.

Leggi di più su IL Custode Qui.

Lucas Nolan è un reporter di Breitbart News che si occupa di questioni di libertà di parola e censura online.