L’amministratore delegato di Anthropic, Dario Amodei, ha dichiarato giovedì che la sua azienda “non può in buona coscienza” consentire al Dipartimento della Guerra di utilizzare i suoi modelli di intelligenza artificiale per tutti gli scopi legali senza restrizioni, nonostante le minacce dei funzionari del Pentagono.

CNBC rapporti che la startup di intelligenza artificiale Anthropic si trova bloccata in trattative controverse con il Pentagono sui termini del suo contratto di difesa, con discussioni in corso fino a giovedì. La disputa è incentrata sull’insistenza di Anthropic su garanzie specifiche riguardo al modo in cui i suoi modelli di intelligenza artificiale possono essere implementati dai militari.

Il ministro della Guerra Pete Hegseth ha intensificato la pressione sulla società, minacciando di designare Anthropic come azienda rischio della catena di fornitura o invocare il Defense Production Act per obbligare al rispetto delle richieste del Pentagono. Queste minacce arrivano mentre il Pentagono cerca l’uso illimitato della tecnologia AI di Anthropic per qualsiasi applicazione militare legale.

Anthropic richiede due assicurazioni specifiche al Dipartimento della Guerra: che i suoi modelli non saranno impiegati in sistemi d’arma completamente autonomi e che non saranno utilizzati per la sorveglianza interna di massa dei cittadini americani. Il Pentagono, tuttavia, vuole la flessibilità necessaria per utilizzare i modelli senza tali limitazioni.

Il portavoce capo del Pentagono Sean Parnell ha affrontato la controversia giovedì, affermando che il Dipartimento di Guerra non ha alcun interesse a utilizzare i modelli di Anthropic per armi completamente autonome o a condurre una sorveglianza di massa degli americani, attività che ha notato essere illegali. Nonostante queste assicurazioni, Parnell ha sottolineato la posizione dell’agenzia secondo cui è necessario un accordo per tutti gli usi legali della tecnologia.

“Questa è una richiesta semplice e di buon senso che impedirà ad Anthropic di mettere a repentaglio operazioni militari critiche e potenzialmente di mettere a rischio i nostri combattenti”, ha scritto Parnell in un post su X. “Non permetteremo a NESSUNA azienda di dettare i termini su come prendiamo decisioni operative”.

In una dichiarazione che affronta la situazione di stallo, Amodei ha riconosciuto il diritto del Pentagono di scegliere appaltatori in linea con la sua visione, ma ha espresso la speranza di una riconsiderazione. “È prerogativa del Dipartimento selezionare gli appaltatori più in linea con la loro visione”, ha scritto Amodei. “Ma dato il valore sostanziale che la tecnologia di Anthropic fornisce alle nostre forze armate, speriamo che ci riconsiderino”.

La situazione si è intensificata questa settimana quando martedì Hegseth ha incontrato Amodei al Pentagono, lanciando un ultimatum che ha dato ad Anthropic tempo fino a venerdì sera per accettare i termini dell’agenzia. In seguito a quell’incontro, mercoledì sera il DoW ha trasmesso alla società quella che un alto funzionario del Pentagono ha definito l’ultima e definitiva offerta.

La disputa mette a rischio una partnership significativa tra Anthropic e l’esercito. L’azienda si è assicurata un contratto da duecento milioni di dollari con il Dipartimento della Difesa a luglio ed è diventata il primo laboratorio di intelligenza artificiale a integrare i suoi modelli nei flussi di lavoro delle missioni su reti classificate, rappresentando una pietra miliare sostanziale nell’adozione dell’intelligenza artificiale militare.

Nonostante il contenzioso in corso, Amodei ha espresso la preferenza per la continuazione della partnership con adeguate garanzie in atto. “La nostra forte preferenza è continuare a servire il Dipartimento e i nostri combattenti di guerra, con le due garanzie richieste in atto”, ha affermato Amodei. Ha aggiunto che se il Dipartimento sceglie di porre fine al coinvolgimento di Anthropic, la società faciliterà una transizione graduale verso un altro fornitore per evitare interruzioni nella pianificazione militare, nelle operazioni o in altre missioni critiche.

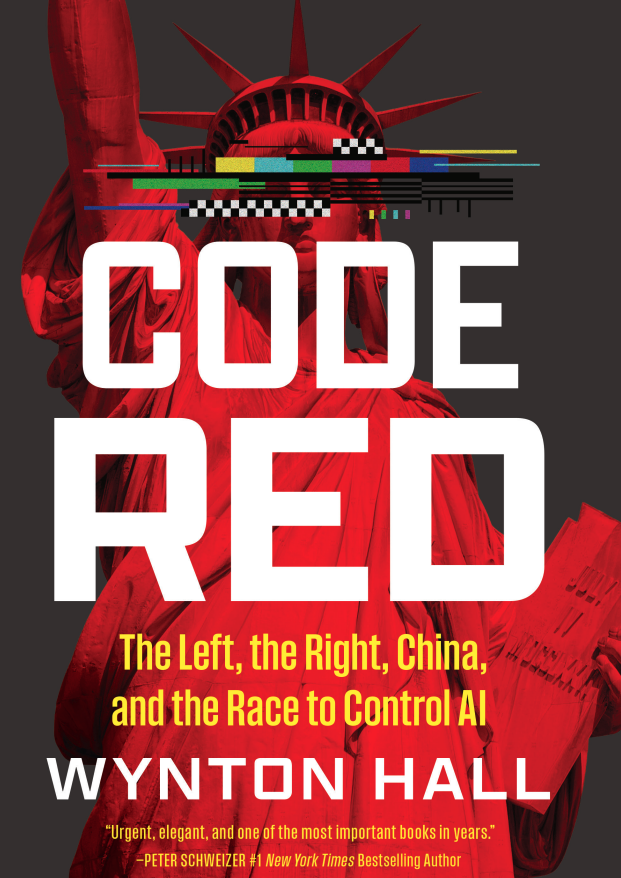

Il modo in cui i conservatori possono sfruttare il potere dell’intelligenza artificiale senza permetterle di trasformare l’America in uno stato di sorveglianza è un argomento chiave del libro di prossima uscita. Codice Rosso: La Sinistra, la Destra, la Cina e la corsa al controllo dell’IAscritto dal direttore dei social media di Breitbart News Wynton Hall.

La senatrice Marsha Blackburn (R-TN), che lo era nominato uno di TEMPOelogiate le 100 persone più influenti nel campo dell’intelligenza artificiale Codice Rosso come una “lettura obbligata”. Ha aggiunto: “Pochi comprendono la nostra lotta conservatrice contro la Big Tech come fa Hall”, rendendolo “qualificato in modo univoco per esaminare come possiamo utilizzare al meglio l’enorme potenziale dell’intelligenza artificiale, garantendo al tempo stesso che non sfrutti bambini, creatori e conservatori”. Il pluripremiato giornalista investigativo e fondatore di Public Michael Shellenberger chiama Codice Rosso “illuminante”, “allarmante” e descrive il libro come “un essenziale punto di partenza per coloro che sperano di sovvertire i piani autocratici delle Big Tech prima che sia troppo tardi”.

Leggi di più su CNBC qui.

Lucas Nolan è un reporter di Breitbart News che si occupa di questioni di libertà di parola e censura online.