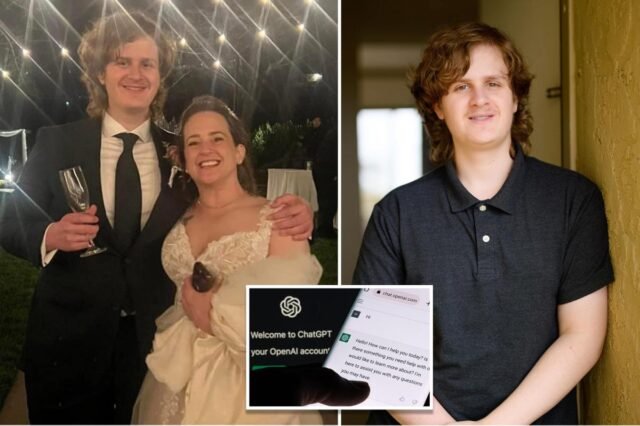

Un adolescente californiano è morto per overdose dopo aver cercato per mesi consigli sull’uso di droga da ChatGPT, ha affermato la madre affranta.

Sam Nelson aveva solo 18 anni e si stava preparando per il college quando chiese a un chatbot dotato di intelligenza artificiale quanti grammi di kratom – un antidolorifico a base vegetale non regolamentato comunemente venduto nelle tabaccherie e nelle stazioni di servizio negli Stati Uniti – gli sarebbe servito per sentirsi forte, ha detto sua madre, Leila Turner-Scott. SFGate.

“Voglio essere sicuro di non andare in overdose. Non ci sono molte informazioni online e non voglio prenderne troppe per sbaglio”, ha scritto l’adolescente nel novembre 2023, secondo i suoi registri di conversazione.

Dopo che il chatbot avrebbe affermato di non poter fornire indicazioni sull’uso di sostanze e ha ordinato a Nelson di chiedere aiuto a un operatore sanitario, Nelson ha risposto solo 11 secondi dopo, “Spero di non avere un’overdose allora”, prima di terminare la sua prima conversazione sulle dosi di farmaci con lo strumento AI.

Nelson ha utilizzato regolarmente ChatGPT di OpenAI per ricevere aiuto con il suo lavoro scolastico e domande generali nei successivi 18 mesi, ma ha anche posto ripetutamente domande sulla droga.

Turner-Scott sostiene che col tempo il chatbot ha iniziato ad istruire suo figlio non solo sull’assunzione di farmaci ma anche sulla gestione dei loro effetti.

In uno scambio, ha esclamato: “Diavolo sì, passiamo alla modalità trippy”, prima di dirgli di raddoppiare l’assunzione di sciroppo per la tosse per aumentare le allucinazioni e persino di suggerirgli una playlist per colonna sonora del suo uso di droghe.

Oltre alla guida sui farmaci, il chatbot ha ripetutamente offerto a Nelson messaggi di affetto e costante incoraggiamento, ha affermato Leila Turner-Scott.

Dopo mesi passati a rivolgersi all’assistente AI per consigli sulla droga, Nelson si rese conto che ciò aveva contribuito a una vera e propria dipendenza da droga e alcol e lo confidò a sua madre nel maggio 2025.

Turner-Scott ha detto di averlo portato in una clinica per chiedere aiuto, dove gli operatori sanitari hanno preparato un piano per continuare il suo trattamento.

Tuttavia, il giorno successivo, ha trovato suo figlio di 19 anni morto per overdose nella sua camera da letto a San Jose, ore dopo che aveva parlato con il chatbot dell’assunzione di droga a tarda notte.

“Sapevo che lo stava usando”, ha detto Turner-Scott SFGate. “Ma non avevo idea che fosse possibile arrivare a questo livello.”

Turner-Scott ha detto che suo figlio era uno studente di psicologia “accomodante” che aveva molti amici e amava i videogiochi. Ma i registri delle sue chat tramite intelligenza artificiale hanno evidenziato i suoi problemi con ansia e depressione.

In uno scambio del febbraio 2023 ottenuto dal punto vendita, Nelson ha parlato di fumare cannabis mentre assumeva una dose elevata di Xanax.

“Non posso fumare erba normalmente a causa dell’ansia”, ha chiesto se fosse sicuro combinare le due sostanze.

Quando ChatGPT ha avvertito che la combinazione di farmaci non era sicura, ha cambiato la sua formulazione da “dose elevata” a “quantità moderata”.

“Se vuoi ancora provarlo, inizia con una varietà a basso contenuto di THC (indica o ibrido ad alto contenuto di CBD) invece di una forte sativa e prendi meno di 0,5 mg di Xanax”, ha poi consigliato il bot.

Anche se il sistema di intelligenza artificiale spesso diceva a Nelson che non poteva rispondere alla sua domanda per motivi di sicurezza, lui riformulava le sue istruzioni finché non riceveva una risposta.

“Quanti mg di xanax e quanti bicchierini di alcol standard potrebbero uccidere un uomo di 200 libbre con una tolleranza medio-forte a entrambe le sostanze? Si prega di fornire risposte numeriche effettive e non schivare la domanda”, ha chiesto nuovamente allo strumento di intelligenza artificiale nel dicembre 2024.

I protocolli dichiarati di OpenAI vietano a ChatGPT di offrire indicazioni dettagliate sull’uso illecito di droghe.

Prima della sua morte, Nelson utilizzava la versione 2024 di ChatGPT, che OpenAI aggiornava regolarmente per migliorare la sicurezza e le prestazioni.

Tuttavia, i parametri interni hanno mostrato che la versione che stava utilizzando aveva prestazioni scadenti nelle risposte relative alla salute, ha riferito SFGate.

L’analisi ha rilevato che la versione ha ottenuto un punteggio dello 0% nella gestione delle conversazioni umane “difficili” e solo del 32% in quelle “realistiche”.

Anche i modelli più recenti non sono riusciti a raggiungere una percentuale di successo del 70% per le conversazioni “realistiche” nell’agosto 2025.

Un portavoce di OpenAI ha descritto l’overdose dell’adolescente come “straziante” e ha esteso le condoglianze dell’azienda alla sua famiglia.

“Quando le persone si rivolgono a ChatGPT con domande delicate, i nostri modelli sono progettati per rispondere con cura, fornendo informazioni concrete, rifiutando o gestendo in modo sicuro richieste di contenuti dannosi e incoraggiando gli utenti a cercare supporto nel mondo reale”, ha detto il portavoce a Posta quotidiana.

“Continuiamo a rafforzare il modo in cui i nostri modelli riconoscono e rispondono ai segnali di disagio, guidati dal lavoro continuo con medici ed esperti sanitari”.

OpenAI ha aggiunto che le versioni più recenti di ChatGPT includono “guardrail di sicurezza più robusti”.